| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

- 통계학

- 활성화 함수

- 코딩테스트

- 인공지능 깃 버전관리

- 대학원 급여

- 대학원 월급

- pandas

- 딥러닝

- 자바 프로젝트

- 파이썬

- 파이썬 경사하강법

- 백준

- 로스트아크

- C# 프로젝트

- 자바 영화 api

- 경사하강법

- 인공지능

- 정규화

- 영화 api

- MLP

- Dehaze

- python

- 머신러닝

- 디자인패턴

- 의료 ai 대학원 월급

- 디자인 패턴

- DCP

- 자바

- API

- 딥러닝 실험 깃 버전관리

- Today

- Total

대학원 일기

딥러닝(Deep learning) 서사 본문

인공지능(Artificial Intelligence)

인공지능(Artificial Intelligence) 서사

인공지능은 사람의 지능(natural intelligence)을 보고 고안한 것이라고 볼 수 있다.

위 사진은 사람의 신경망(Neural Network)이다. 이를 크게 간단히 분석하면 신경세포체, 축삭돌기, 가지돌기로 분류할 수 있다. 신경망은 신경세포체에서 자극을 받아 정보를 받으면 축삭돌기를 지나 가지돌기로 전달한다. 인공지능은 아래 사진처럼 입력층(Input layer)에서 출력층(Output layer)로 전달한다.

하지만, 최근에 위 주장은 달라지고 있다.

위 사진은 모두 사람이 날 수 있게 하는 비행기이다. 초기(1897)의 비행기는 하늘을 나는 새의 형상을 보고 고안되었지만, 1903년부터 오늘날의 비행기 형상을 띈 것을 볼 수 있다. 오늘날의 비행기에서 새의 형상보다는 비행의 효율성을 따지면서 만든다. 이처럼 인공지능의 시작은 분명히 인간의 뇌를 모방한 것이 맞지만, 지금은 인공지능 그 자체의 모델을 놓고 수학적으로 분석하여 어떠한 목적에 따른 최적의 효율성을 찾는 것이다.

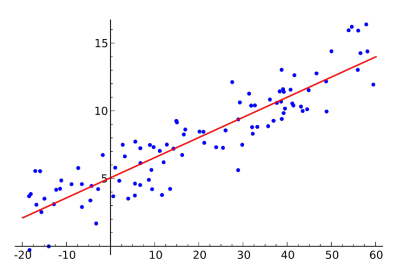

Linear Neural Network

Linear function은 가장 간단한 신경망으로 선형 모델이다.

선형 모델은 주로 MSE(Mean Squared Error)로 Loss를 계산한다. Model은 $y=wx+b$를 사용한다. 여기서 $w$는 가중치(weight)를 의미하고, $b$는 편향값(bias)을 의미한다. 가중치(weight)와 편향값(Bias)은 아래처럼 업데이트된다.

이는 경사하강법을 통해 Loss식(MSE)에서 가중치(w)에 대해 미분한 값을 w로 업데이트하고, 마찬가지로 편향값(b)도 Loss식(MSE)에 대해 편향값(b)에 대해 미분한 값을 b로 업데이트한 것이다.

Nonlinear Model

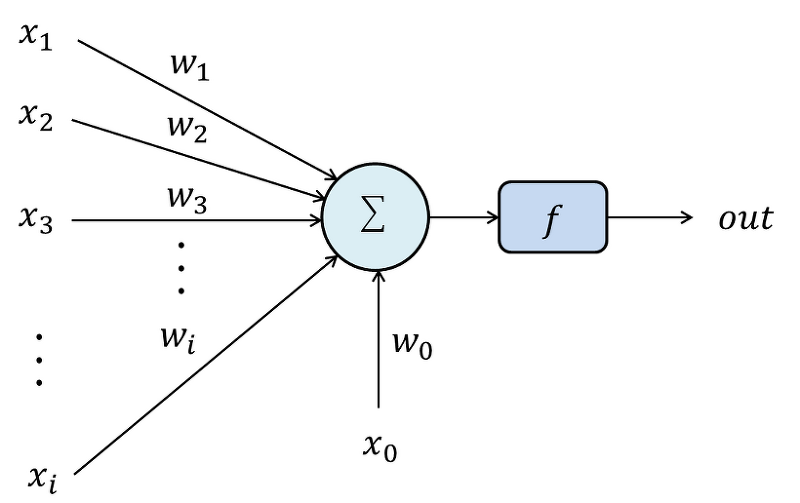

위 선형모델과 다른 비선형 모델은 비선형 모델이 나타내는 함수가 곡선형태를 나타내고 선형 모델이 단점(XOR문제)을 해결한다. 아래 사진은 인공지능 초기 모델로 퍼셉트론이다.

<단층 퍼셉트론, 이하 SLP> |

<다층 퍼셉트론, 이하 MLP> |

단층 퍼셉트론은 입력층과 출력층으로만 이루어진 선형모델이고, 다층 퍼셉트론은 입력층과 은닉층, 출력층으로 이루어져있다. MLP는 SLP가 XOR 문제를 해결하지 못했던 것을 입력층과 출력층 사이에 은닉층을 둠으로써 해결한다.

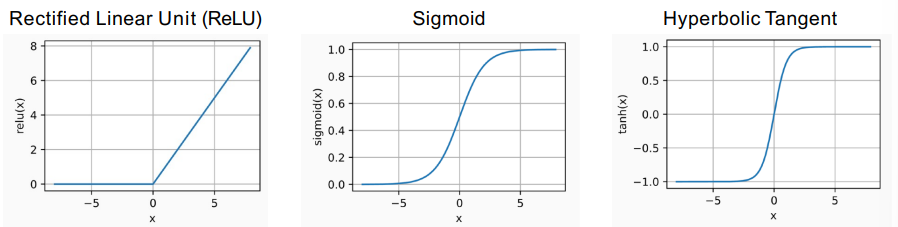

또한, 많은 양의 데이터를 다룰 때, 활성화 함수(Activation function)로 더 효율적으로 다룰 수 있도록 해준다. 활성화 함수는 대표적으로 ReLU, Sigmoid, tanh가 있다.

위 활성화 함수들은 문제와 상황마다 어떤 게 좋은 지 모르므로 모델 개발자가 잘 선택해야 한다. 또한, 인공지능 모델은 활성화 함수라는 Learn linear transform이 들어가야 네트워크를 깊게 쌓았을 때 의미가 있어진다.

Loss functions(Cost function)

손실함수는 인공지능 모델이 다루는 taret_data(실제값)와 predict_data(예측값)의 차이를 계산하는 함수이다.

주로 회귀(Regression) 문제를 다룰 때에는 MSE(Mean Squarded Error)를 사용한다.

주로 분류(Classification) 문제를 다룰 때에는 CE(Cross Entropy)를 사용한다.

주로 확률적(Probabilistic) 문제를 다룰 때에는 MLE(Maximum Likelihood Error)를 사용한다.

위에서 다룬 내용들은 인공지능을 모델링할 때 중요하므로 설계할 때 선택과 집중을 명심해야 한다.

'AI > 인공지능 기초' 카테고리의 다른 글

| 머신러닝(ML)과 딥러닝(DL)의 차이 (0) | 2022.03.14 |

|---|---|

| 딥러닝: 최적화(Optimization) (0) | 2022.03.07 |

| MNIST 데이터 학습 (0) | 2022.02.23 |

| Machine Learning & Pytorch(Tensor Manipulation) (0) | 2022.02.22 |

| 파이썬 시각화툴(Matplotlib) (0) | 2022.02.14 |