| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

- 의료 ai 대학원 월급

- 파이썬

- 대학원 급여

- 자바 프로젝트

- 인공지능 깃 버전관리

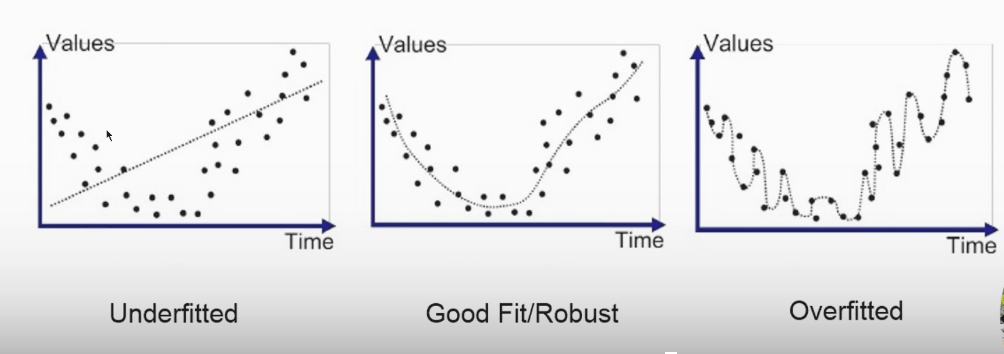

- 경사하강법

- 활성화 함수

- 딥러닝 실험 깃 버전관리

- 정규화

- Dehaze

- API

- DCP

- 머신러닝

- 백준

- 인공지능

- 코딩테스트

- 디자인패턴

- 파이썬 경사하강법

- 대학원 월급

- MLP

- 통계학

- pandas

- 딥러닝

- 로스트아크

- 영화 api

- python

- C# 프로젝트

- 자바 영화 api

- 자바

- 디자인 패턴

- Today

- Total

대학원 일기

인공신경망과 딥러닝 본문

1. 인공신경망과 딥러닝

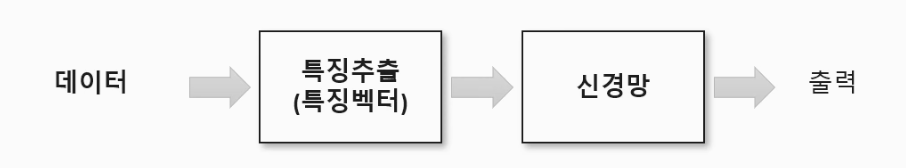

일반적으로 인공신경망은 은닉층이 소수인 반면, 딥러닝은 은닉층이 다수 포함된 심층신경망(deep neural network)형태 - 일반 신경망 : 데이터에서 직접 특징(handcrafted feature)을 추출해서 만든 특징 벡터(feature vector)를 입력으로 사용하고, 특징 벡터들의 품질에 영향

- 딥러닝 신경망 : 특징 추출과 학습을 함께 수행하고, 데이터로부터 효과적인 특징을 학습을 통해 추출하여 우수한 성능 달성

일반 신경망은 사람의 개입이 있는 반면 딥러닝 신경망은 사람의 개입없이 생기는 편향과 오류가 적고 성능과 추론이 좋다는 차이가 있다.

딥러닝은 높은 성능과 뛰어난 확장성으로 이미지 처리, 자연어 처리, 음성 인식과 같은 분야에서 급격한 발전이 이루어지고 있으며 필요한 파라미터 수가 많아서 더 많은 학습 데이터가 필요하고, 최적의 모델과 훈련을 위해 많은 시간과 비용 필요

2. 기울기 소멸 문제

은닉층의 수가 많을 수록 더 복잡한 문제를 해결할 수 있지만, 너무 깊으면 역전파를 위해 가중치와 바이어스를 변경하는 수학적인 방법인 미분이 불가능해져 0으로 수렴되는, 즉 소멸되는 문제가 존재함.

활성화 함수 : 이전 단계에서 다음 단계에 미치는 영향(가중치)를 찾는데 적합한 통계적 함수

기존에는 선형(linear)함수, 시그모이드(sigmoid, logistic)함수 등만 적용. 그 이후엔 ReLU, ELU등 다양한 함수를 적용하여 인공신경망 문제를 해결하려 노력이 있었다.

3. 과적합(Overfitting)

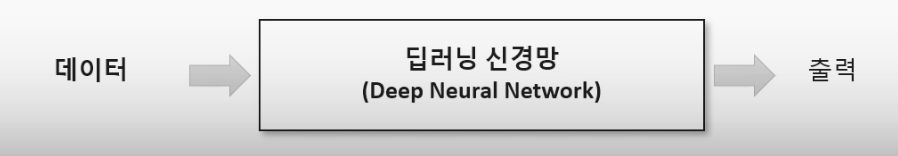

모델이 학습 데이터에 지나치게 맞추어진 상태를 과적합이라 부르고 과적합된 모델은 학습되지 않은 데이터에 대해 성능 저하 과소적합(underfitting)은 모델이 작거나 단순해서 데이터를 잘 표현하지 못한 상태로 모델의 크기를 키우거나 좋은 모델로 변경이 필요

- 규제화(Regularization)기법 : 큰 가중치 값에 큰 규제를 가하여 과적합되지 않도록 모델을 제한, 규제의 강도를 정하는 적절한 가중치가 중요

- 드롭아웃(Dropout)기법 : 노드들을 일정 확률로 무작위 선택하여 연결된 가중치 연결선을 없는 것으로 간주하고 학습하는 방법

- 배치 정규화(Batch Normalization)기법 : 모델에 입력되는 샘플들을 균일하게 만드는 방법으로 미니 배치 단위로 평균이 0, 표준편차가 1이 되도록 정규화

4. 딥러닝의 발전

딥러닝 혁명의 아버지들(안중요할거 같음)

제프리 힌튼(Geoffrey Hinton)

조슈아 벤지오(Yoshua Bengio)

얀 르쿤(Yann LeCun)

딥러닝에 제일 널리 쓰이는 프레임워크들

-

텐서플로우(TensorFlow)

-

케라스(Keras)

-

파이토치(PyTorch)

- 전이 학습(Transfer Learning) : 대용량 데이터로 사전 학습된 모델을 이용해 훈련 시간과 비용을 줄임.

- 자기지도학습(Self-supervised Learning) : 레이블이 없는 데이터를 자기 스스로 학습

- 메타 학습(meta Learning) : 학습 방식을 학습(learn to learn)하여 인간과 같이 적은 데이터로도 빠르게 학습하는 방법

- 설명가능한 인공지능(Explainable AI, XAI) : 신경망 모델의 내부나 동작 원리를 파악할 수 있도록 하는 기법

- NAS(Neural Architecture Search) : 최적의 딥러닝 모델을 자동으로 찾아주는 방법

- AutoML : 강화학습 방식으로 최적의 딥러닝 모델 생성

1-6 마무리하며

강의정리

-

인공신경망은 인간 두뇌에 대한 계산적 모델을 통해 인공지능을 구현하려는 분야

-

생체신경망을 모방해서 만든 퍼셉트론과 다층퍼셉트론 그리고 역전파 알고리즘

-

인공신경망은 은닉층이 소수인 반면, 딥러닝은 은닉층이 다수 포함된 심층신경망

-

딥러닝의 문제점인 기울기 소멸 문제와 과적합 문제를 해결하여 계속해서 발전

'AI > 인공지능 기초' 카테고리의 다른 글

| 딥러닝 구조와 모델 (0) | 2023.12.06 |

|---|---|

| 텐서 (Tensor) (0) | 2023.12.06 |

| Deep Learning Layer: Convolution Layer (0) | 2023.11.20 |

| Deep Learning Layer: Linear Layer (1) | 2023.11.20 |

| Embedding, Recurrent Layer (0) | 2023.11.13 |